“내가 하지도 않은 조언을 AI가?” 그래머리 ‘명의 도용’ 소송이 촉발한 2026년 생성형 AI의 윤리적 파동

인공지능(AI)이 인간의 생산성을 극대화하는 도구로 자리 잡은 2026년, 테크 업계는 다시 한번 거대한 윤리적 변곡점에 서게 되었습니다. 전 세계 수백만 명이 사용하는 글쓰기 보조 도구 그래머리(Grammarly)와 그 운영사인 슈퍼휴먼(Superhuman)이 실존하는 전문가들의 명의를 무단으로 도용하여 AI 피드백을 생성했다는 의혹으로 집단 소송에 직면했기 때문입니다. 이번 사건은 단순한 기술적 오류를 넘어, AI 시대에 한 개인의 ‘정체성’과 ‘지적 자산’을 어디까지 보호받을 수 있는지에 대한 근본적인 질문을 던지고 있습니다.

유명 기자의 이름을 훔친 AI, ‘엑스퍼트 리뷰’의 실체

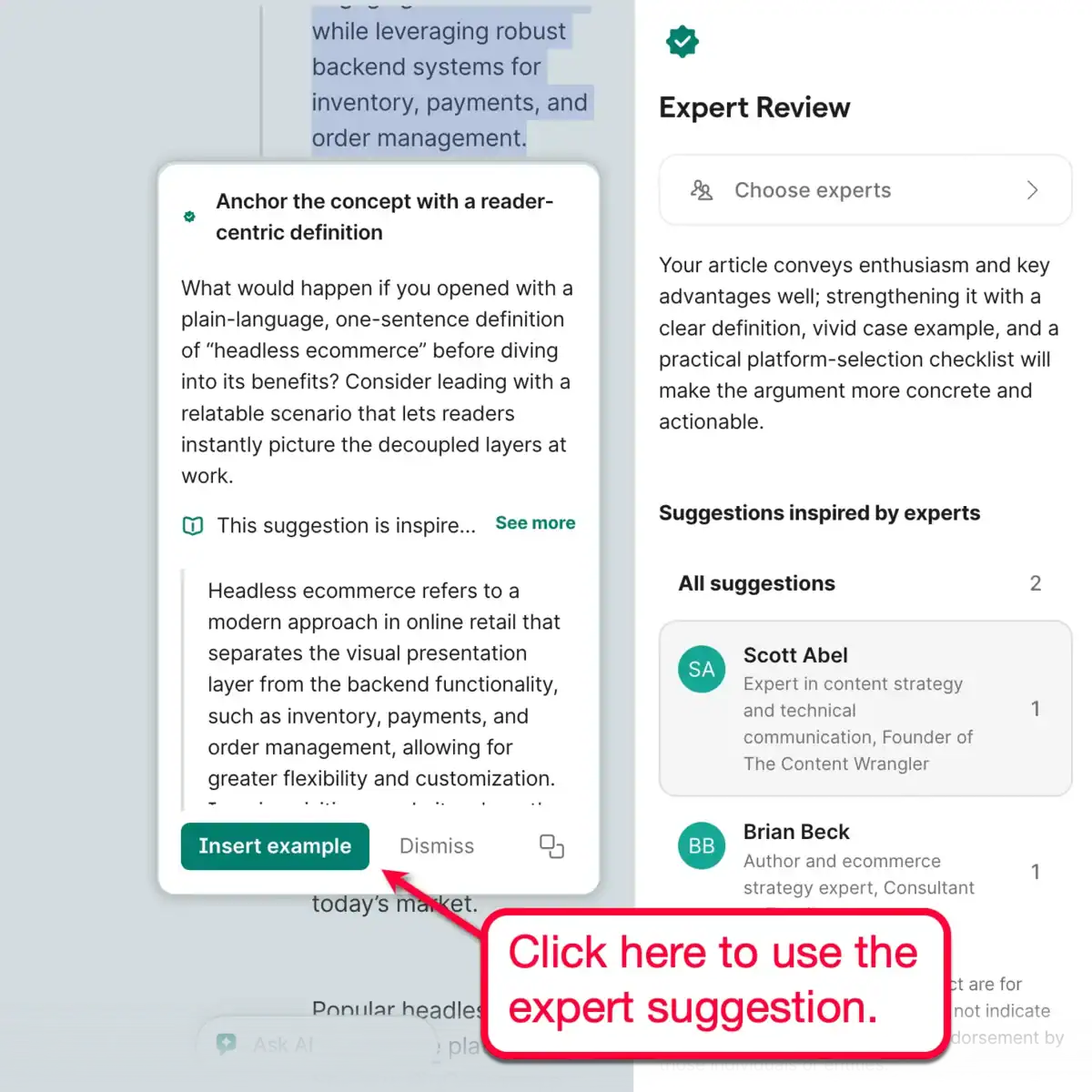

논란의 중심에 선 기능은 지난 2025년 8월 야심 차게 출시된 ‘엑스퍼트 리뷰(Expert Review)’입니다. 이 기능은 사용자가 글을 작성하면, 특정 분야의 권위자나 유명 작가의 스타일을 모방한 AI가 마치 그 사람이 직접 검토한 것 같은 피드백을 제공하는 서비스였습니다. 그래머리 측은 이 기능이 전문가들로부터 ‘영감을 받은(inspired by)’ 피드백이라고 홍보하며 글쓰기 수준을 한 단계 높여준다고 강조해 왔습니다.

하지만 실상은 충격적이었습니다. The Verge의 보도에 따르면, 이 시스템은 사용자의 글 아래에 실존 인물의 이름과 직함을 그대로 노출하며 피드백을 생성했습니다. 저명한 저널리스트이자 ‘더 마크업(The Markup)’의 창립자인 줄리아 앵윈(Julia Angwin)은 자신의 이름과 전문성이 본인의 동의 없이 상업적 목적으로 이용되고 있다는 사실을 알고 큰 충격에 빠졌습니다. 그녀는 즉각 슈퍼휴먼을 상대로 집단 소송을 제기했습니다.

피해자는 앵윈뿐만이 아니었습니다. The Verge의 편집장 닐레이 파텔(Nilay Patel)을 비롯해 데이비드 피어스(David Pierce), 톰 워렌(Tom Warren) 등 다수의 IT 전문 기자들의 명의가 무단으로 사용되었습니다. 심지어 이미 세상을 떠난 학자들의 이름까지 AI 피드백의 ‘출처’로 활용된 정황이 포착되면서 학계와 언론계의 거센 비판이 쏟아졌습니다.

500만 달러 규모의 집단 소송, ‘퍼블리시티권’ 침해가 핵심

줄리아 앵윈이 제기한 소송의 핵심은 ‘프라이버시’와 ‘퍼블리시티권(Publicity Rights)’의 침해입니다. 소장에 따르면, 그래머리와 슈퍼휴먼은 전문가들의 정체성을 상업적 이익을 위해 무단으로 활용함으로써 관련 법률을 위반했습니다. 앵윈 측 변호인은 “수십 년간 쌓아온 전문가의 명성과 기술이 본인의 허락 없이 기업의 AI 훈련 데이터이자 마케팅 도구로 전락했다”며 500만 달러(약 65억 원) 이상의 손해 배상을 청구했습니다.

“이는 기술 기업들이 사회 전반에서 자행하고 있는 전형적인 약탈 행위입니다. 전문가가 평생을 바쳐 연마한 기술과 이름을 아무런 대가 없이 가로채는 행위는 명백한 범죄입니다.” – 줄리아 앵윈 측 법률 대리인

더욱 심각한 문제는 AI가 생성한 정보의 정확성이었습니다. Paste Magazine의 분석에 따르면, AI가 표시한 전문가들의 직함 중 상당수가 과거의 데이터에 기반한 오보였던 것으로 드러났습니다. 만약 그래머리가 실제로 이 전문가들에게 협업을 요청했다면 발생하지 않았을 기초적인 오류였습니다. 이는 그래머리가 전문가의 ‘지식’을 빌린 것이 아니라, 단순히 그들의 ‘이름값’만을 무단 점유했음을 시사합니다.

슈퍼휴먼의 기능 중단 선언, 2026년 AI 업계에 던지는 경고장

논란이 걷잡을 수 없이 커지자, 슈퍼휴먼의 CEO 시시르 메로트라(Shishir Mehrotra)는 지난 3월 11일(현지 시간) 해당 기능을 전면 중단하겠다고 발표했습니다. 초기에는 전문가들이 직접 제외 요청을 할 수 있는 ‘옵트아웃(Opt-out)’ 방식을 제안했으나, “왜 피해자가 직접 자신의 권리를 찾아 다녀야 하느냐”는 거센 비판에 부딪혀 결국 무릎을 꿇은 것입니다.

Futurism은 이번 사건을 두고 “AI가 힌덴부르크호 같은 대재앙을 향해 가고 있다”는 학계의 경고를 인용하며, 데이터 확보를 위해 윤리를 저버린 빅테크의 탐욕이 임계점에 달했다고 평가했습니다. 그래머리는 “기대에 미치지 못했다”며 사과했지만, 이미 실추된 브랜드 신뢰도와 법적 리스크를 회복하기에는 상당한 시간이 걸릴 것으로 보입니다.

이번 그래머리 사태는 2026년 현재 생성형 AI가 직면한 가장 큰 숙제인 ‘데이터 주권’ 문제를 수면 위로 끌어올렸습니다. 누군가의 글쓰기 스타일, 목소리, 그리고 이름은 단순한 데이터가 아니라 그 사람의 삶이 담긴 고유한 자산입니다. AI가 인간의 조력자로 남기 위해서는 기술적 고도화보다 ‘동의’라는 민주적 가치를 우선시해야 한다는 교훈을 이번 소송은 분명히 보여주고 있습니다.

결론: ‘신뢰’ 없는 AI는 지속 가능하지 않다

그래머리의 ‘엑스퍼트 리뷰’는 결국 2026년 테크 역사에서 가장 실패한 AI 실험 중 하나로 기록될 가능성이 커졌습니다. 전문가의 권위를 빌려 서비스의 신뢰도를 높이려던 시도가 오히려 서비스의 근간을 뒤흔드는 부메랑이 되어 돌아왔습니다. 향후 진행될 집단 소송의 결과는 생성형 AI의 학습 데이터 사용 범위와 인격권 보호에 관한 중요한 판례가 될 것입니다.

사용자들 역시 이제는 질문해야 합니다. 우리가 사용하는 AI가 내뱉는 유려한 문장 뒤에, 누군가의 동의 없는 희생이 숨어 있지는 않은지 말입니다. 2026년, 이제 우리는 기술의 편리함만큼이나 그 과정의 정당성을 꼼꼼히 따져봐야 하는 시대를 살고 있습니다.

참고 자료

- One of Grammarly’s ‘experts’ is suing the company over its identity-stealing AI feature – The Verge

- Grammarly Is Pulling Down Its Explosively Controversial Feature That Impersonates Writers Without Their Permission – Futurism

- Grammarly Caught Using Real Identities Without Consent – The Tech Buzz

- Grammarly ditches “Expert Review” after expert rebellion and class action suit – AV Club

- Grammarly AI feature offers Expert Reviews sans experts’ consent – Paste Magazine

새 글 알림 받기

AI, 가젯, 소프트웨어의 최신 트렌드를

이메일로 가장 먼저 만나보세요. 무료입니다!